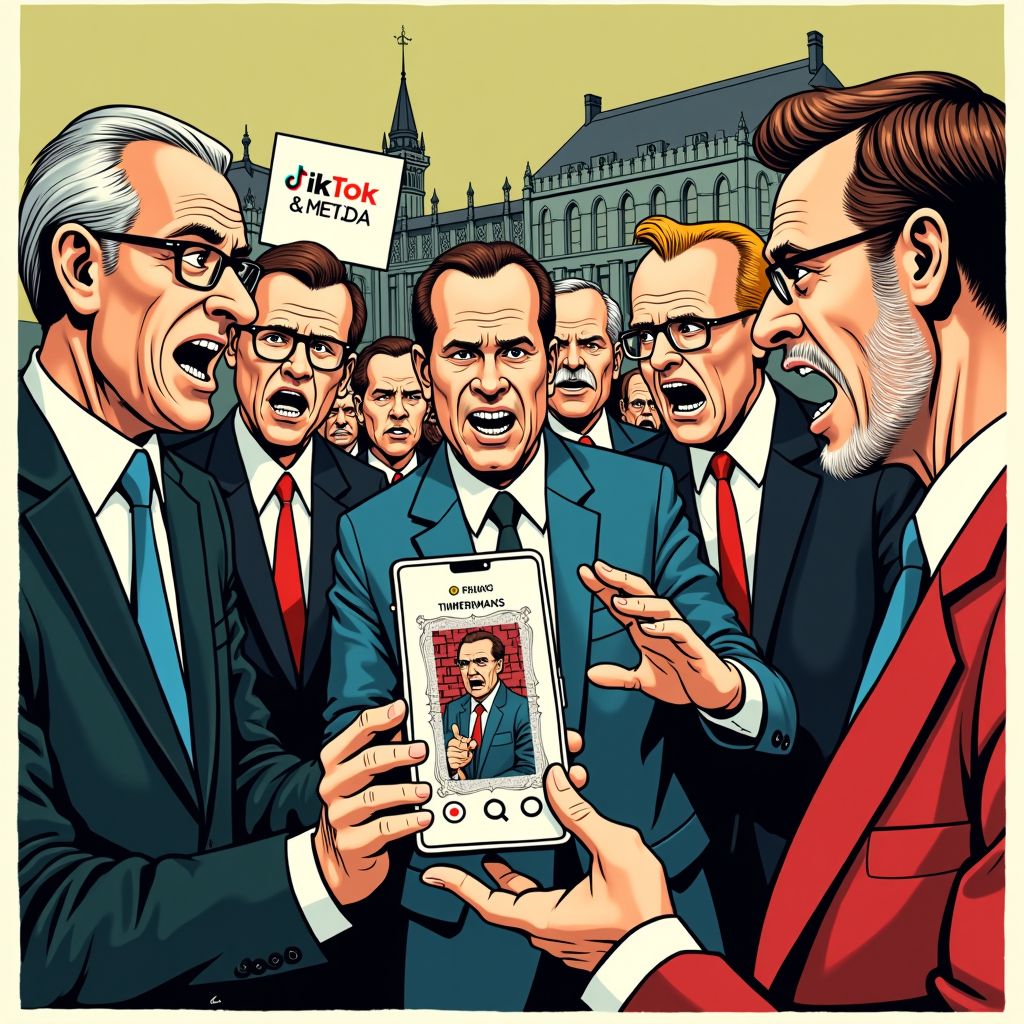

kamerleden furieus over algoritmische veiligheid: 'onze democratie wordt ondermijnd'

Den Haag, donderdag, 5 maart 2026.

Parlementsleden zijn woedend op TikTok, Meta en Google. Ze noemen de algoritmes gevaarlijk. Schadelijke en verslavende content wordt massaal verspreid. Jongeren lopen risico. Er is sprake van verkiezingsbeïnvloeding. Ondanks meldingen blijft extreem materiaal online. Een AI-video met geweld tegen Frans Timmermans werd 300.000 keer bekeken voordat hij verwijderd werd. Kamerleden spreken van bagatellisering. Ze eisen transparantie. De technologiegiganten zeggen alles te doen, maar leveren onvoldoende bewijs. De kloof tussen politiek en techbedrijven is groter dan ooit. Parlementaire controle op digitale platformen neemt toe.

frustratie in de tweede kamer over algoritmische veiligheid

Kamerleden van diverse fracties, waaronder GroenLinks-PvdA, D66, VVD en Volt, hebben op 4 maart 2026 hun zorg geuit over de rol van algoritmes van TikTok, Meta en Google in de verspreiding van schadelijke content [1]. Vertegenwoordigers van de techbedrijven werden verweten dat zij de ernst van verslaving, radicalisering en verkiezingsbeïnvloeding bagatelliseren [2]. De discussie vond plaats tijdens een rondetafelgesprek in de Tweede Kamer, georganiseerd door de commissie Digitale Zaken [3].

experts wijzen op systemische misstanden

Pieter van Boheemen van Post-X Society presenteerde cijfers over 250 illegale politieke advertentiecampagnes op Meta-platformen [3]. Hij noemde trollenlegers, AI-gegenereerde haatvideo’s en ongemodereerde extremistische streams als reële dreigingen [4]. Volgens hem is geen enkel algoritme politiek neutraal, omdat het wordt gevormd door menselijke keuzes [5]. Die gebrekkige modellen kunnen democratische processen ondermijnen [5].

politici klagen over gebrek aan transparantie

Barbara Kathmann (GroenLinks-PvdA) stelde dat de algoritmes van sociale mediaplatformen ziek zijn en dat ze de rode loper uitschuiven voor verkiezingsinmenging [1][4]. Laurens Dassen (Volt) vroeg zich hardop af waarom techbedrijven moderatoren ontslaan terwijl de druk op contentmoderatie juist toeneemt [5]. Kamerleden eisen meer transparantie over hoe algoritmes functioneren en welke content wordt gepromoot [5].

techbedrijven ontkennen structurele problemen

Vertegenwoordigers van Meta en TikTok ontkennen dat hun algoritmes structurele problemen veroorzaken [4]. Edo Haveman van Meta beweert dat het overgrote deel van de content op hun platforms liefdevol en positief is [1][2]. Thierry Marchand-Huijser van TikTok stelt dat 98,2 procent van de schadelijke content actief wordt verwijderd [2]. Beide bedrijven wijzen erop dat zij continue investeringen doen in veiligheid [3].

bewijslast blijft liggen bij techbedrijven

Een gewelddadige AI-video gericht tegen Frans Timmermans werd meer dan 300.000 keer bekeken voordat hij verwijderd werd, ondanks meldingen [5]. Queeny Rajkowski (VVD) noemde dit een zorgwekkend signaal over prioriteiten binnen de bedrijven [4]. Sarah El Boujdaini (D66) concludeerde dat de verhalen van de platformen “niet te rijmen” zijn met de bevindingen van experts [5]. De kloof tussen beleid en praktijk blijft groot [5].

jongeren en democratie onder druk

Kathmann waarschuwt dat jongeren psychisch worden belast door verslavende en radicale content op sociale media [5]. Kinderen worden volgens haar geronseld voor criminaliteit via algoritmes [5]. Tegelijkertijd detecteren experts duizenden nepaccounts en trollenlegers, zoals 550 gevonden tijdens de landelijke verkiezingen van 2025 [5]. Deze patronen herhalen zich nu rond de gemeenteraadsverkiezingen van 18 maart 2026 [3].